- Publié le

Un énorme article sur l'IA vient de paraître aujourd'hui !

- Auteurs

- Nom

- AbnAsia.org

- @steven_n_t

Groupe massif de chercheurs de 20 universités et laboratoires d'intelligence artificielle

Un groupe de chercheurs de 20 universités et laboratoires d'IA (dont l'Université Stanford, l'Université Yale, CIFAR, Google DeepMind, Microsoft Research, MetaGPT et bien d'autres) a publié un rapport technique de 264 pages (ou devrais-je dire un livre ?) sur la prochaine évolution des LLM.

C'est ce qu'ils appellent des "Agents de fondation".

En parcourant les pages, quelques perspectives intéressantes ressortent :

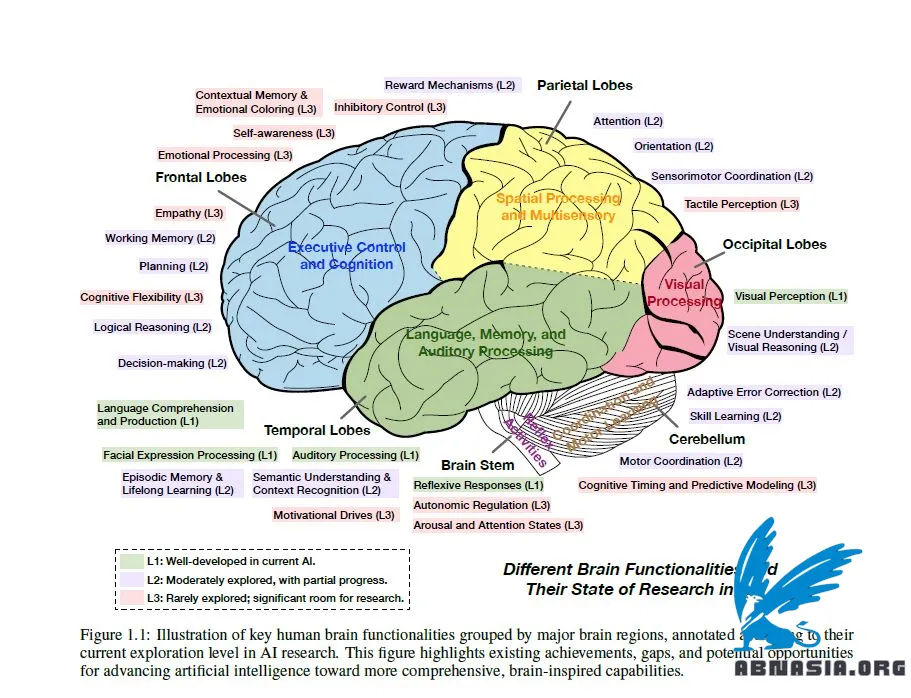

Les agents ont des architectures modulaires inspirées du cerveau Les chercheurs décomposent les agents d'IA en composants cognitifs (mémoire, raisonnement, émotion et récompense) qui reflètent étroitement les régions du cerveau humain. Un plan pour des systèmes évolutifs et adaptatifs.

L'auto-optimisation continue pour une véritable autonomie Au-delà d'une simple mise à jour de prompt, ces agents de fondation utilisent des boucles d'optimisation basées sur les LLM pour affiner leurs propres flux de travail, stratégies de planification et utilisation d'outils.

Collaboration multi-agents --> Intelligence collective Ils explorent la façon dont les agents peuvent partager des informations, coordonner des tâches et même présenter des comportements émergents lorsqu'ils travaillent en groupe. Ils soulignent l'importance de la conception de protocoles pour assurer la résolution de problèmes basée sur l'équipe.

Comment les agents perçoivent le monde L'enquête explique divers paradigmes (implicite vs. explicite vs. basé sur simulateur) pour la façon dont les agents "comprent" leur environnement. Il est tout aussi important de concevoir des systèmes de mémoire à long et à court terme pour supporter la continuité du contexte et éviter l'oubli catastrophique.

Alignement et "suralignement" Ils mettent en évidence les vulnérabilités (comme les injections de prompt, l'empoisonnement de modèle, les hallucinations) et proposent un alignement multi-objectif - afin que les agents augmentent leurs performances et leur sécurité. Le concept de "suralignement" relie les objectifs d'alignement aux mises à niveau techniques de chaque sous-système. Ils introduisent la règle AI-45° : une ligne directrice conceptuelle pour équilibrer les améliorations des performances avec les améliorations de l'alignement.

Dans l'ensemble, cette recherche colossale pourrait bien être la lecture la plus complète sur l'état actuel (et futur) des agents d'IA à ce jour.

PS : Imaginez si nous découvrons que tout cela a été écrit par un agent. :P

Veuillez noter que la version française est assistée par Ai, des erreurs mineures peuvent donc exister.

Auteur

AiUTOMATING PEOPLE, ABN ASIA a été fondée par des personnes ayant des racines profondes dans le milieu académique, avec une expérience professionnelle aux États-Unis, aux Pays-Bas, en Hongrie, au Japon, en Corée du Sud, à Singapour et au Vietnam. ABN ASIA est l'endroit où l'académie et la technologie rencontrent l'opportunité. Avec nos solutions de pointe et nos services de développement logiciel compétents, nous aidons les entreprises à se développer et à s'imposer sur la scène mondiale. Notre engagement : Plus vite. Mieux. Plus fiable. Dans la plupart des cas : moins cher également.

N'hésitez pas à nous contacter chaque fois que vous avez besoin de services informatiques, de conseils en matière de numérique, de solutions logicielles prêtes à l'emploi, ou si vous souhaitez nous envoyer des demandes de propositions (RFP). Vous pouvez nous contacter à l'adresse [email protected]. Nous sommes prêts à vous aider avec tous vos besoins technologiques.

© ABN ASIA